Непослушные роботы Айзека Азимова

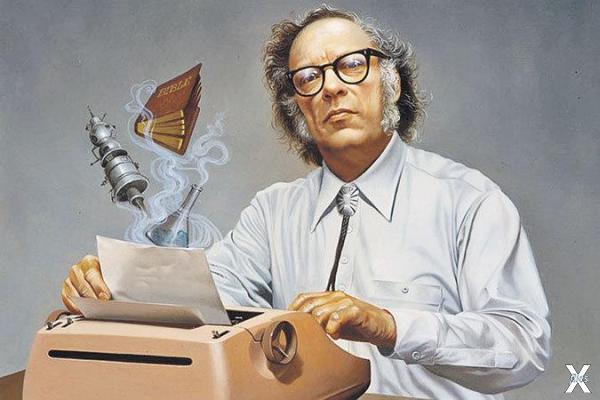

Пожалуй, одним из самых известных футурологов прошлого столетия был знаменитый американский писатель-фантаст и популяризатор науки Айзек Азимов (1920-1992). Поскольку по основной профессии Азимов являлся ученым-биохимиком, его «предсказания» не основывались на одном лишь писательском воображении. В 1964 году по просьбе журналистов он попробовал представить себе, какой может стать наша жизнь через 50 лет. Впоследствии оказалось, что семь из десяти сделанных им прогнозов полностью или частично сбылись.

Пророк XX века

Писатель сказал, что телефоны станут беспроводными и с экраном, а связь между абонентами на разных континентах будет осуществляться через спутники. «Вы сможете видеть человека, которому звоните. Дисплей можно будет использовать для просмотра документов, фотографий и чтения книг. Будут созданы миниатюрные электронные вычислительные машины, источником энергии для которых станут литий-ионные аккумуляторы».

Предвидел Азимов и появление телевизоров с плоскими экранами вместо обычных, и возникновение «объемного» кино.

По поводу бытовой техники писатель спрогнозировал, что со временем она будет снабжена таймерами, большая ее часть станет беспроводной. Еще писатель объявил, что будут строиться огромные электростанции в пустынях. Они уже появились, но пока их не так много.

Законы роботехники

Но больше всего прославили Азимова как футуролога три закона роботехники, впервые упомянутые им в рассказе «Хоровод» (1942).

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат первому закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит первому или второму законам.

Позднее, в 1986 году, в романе «Роботы и Империя», Азимов добавил еще и нулевой закон роботехники: «Робот не может причинить вред человечеству или своим бездействием допустить, чтобы человечеству был причинен вред».

Правда, хоть Азимову и приписывают авторство пресловутых роботехнических законов, окончательно сформулировал их не он, а его друг Джон Кэмпбелл, главный редактор журнала фантастики Astounding, вычленивший содержание законов из написанных Азимовым текстов. Тем не менее писатель никогда не отказывался от авторства и не раз упоминал о трех законах в своем творчестве.

Так, в эссе «Законы роботехники» Азимов писал, что действие трех законов можно распространить на все созданные человеком инструменты, а также социальные институты. Их суть в том, чтобы служить людям, не нанося им вреда и не нарушая их безопасности.

Опасность для будущего

И коллеги-фантасты, и ученые отнеслись к выкладкам Азимова достаточно серьезно. Им удалось обнаружить в трех законах немало противоречий, вследствие которых они малоприменимы на практике в наше время, когда технологии искусственного интеллекта наконец переживают бурное развитие.

Например, специалист по научной фантастике Роберт Сойер рассуждает: «Развитие искусственного интеллекта - это бизнес, а бизнес, как известно, не заинтересован в развитии коренных мер безопасности - особенно философских. Вот несколько примеров: табачная индустрия, автомобильная промышленность, ядерная промышленность. Ни для одной из них изначально не было сказано, что серьезные меры безопасности необходимы, и все они препятствовали внешне налагаемым ограничениям, и ни одна из них не приняла абсолютный эдикт против причинения вреда людям».

Но даже если иметь в виду только роботов, то законы роботехники являются скорее идеалом, чем реально работающим механизмом. Ведь, во-первых, роботу не всегда объяснишь, как верно поступать в той или иной ситуации, во-вторых, соблюдая законы, роботы ограничивают свободу людей, а это далеко не всегда идет на пользу, хотя вред может оказаться неочевидным и «отсроченным». Так, машины могут подобным образом лишать людей возможности совершать рискованные действия, направленные на различные открытия, создание изобретений и креативных проектов, которые в конечном счете будут способствовать прогрессу.

Тем не менее многие взяли три закона роботехники на вооружение. В 2007 году южнокорейское правительство начало разработку «Устава этических норм для роботов», основные положения которого напоминают азимовские законы.

Елиезер Юдковски из американского Института сингулярности (SIAI) изучает проблемы глобального риска, которые возникнут, если будущий искусственный сверхинтеллект не запрограммируют на дружественность по отношению к человеку. В 2004 году при SIAI был открыт сайт AsimovLaws.com, где обсуждались проблемы этики искусственного интеллекта. В частности, участники дискуссий пытались доказать, что применение трех законов роботехники небезопасно для человечества, так как, следуя им, машины могут захватить власть на Земле, дабы «защитить» людей от вреда.

Защита от дурака

И все-таки представим себе, что произошло бы, если бы законы, разработанные Азимовым и Кэмпбеллом много десятилетий назад, осуществлялись на практике хотя бы частично... Недавно команда специалистов из Университета Тафтса (США) разработала систему искусственного интеллекта, которая позволяет последнему отказываться выполнять приказы оператора при наличии на то достаточных оснований. Новинка была представлена на технологической конференции AI-HRI.

Принцип работы системы выглядит так. Получив от человека приказ, машина приступает к проверке условий его выполнения. Среди них наличие необходимых навыков, физическая возможность исполнения приказа вообще и с учетом текущих обстоятельств, а также такой параметр, как «субординация» - проверка того, обязан ли робот выполнять приказы, поступившие именно от этого оператора.

Если робот обнаруживает причины, по которым приказ не может быть выполнен, он уведомляет об этом человека. Однако после уточнения исходных данных машина может «передумать» и приступить к выполнению поставленной перед ней задачи.

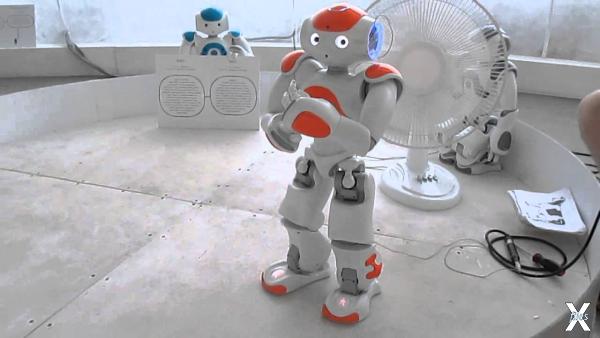

В качестве примера ученые записали несколько видеороликов, в которых действует робот по имени Nao. В каждом из них оператор отдает роботу устные приказы, которые тот отказывается выполнять по разным причинам. При этом в двух случаях машина все же выполняет указание после того, как оператор уточняет данные, а в третьем отказывается его выполнять «наотрез», поскольку оператор не обладает необходимыми полномочиями.

Между тем некоторые исследователи в области робоэтики (этических аспектов роботехники), такие как Кейтлин Ричардсон и Эрик Бриллинг, считают, что подобные разработки противоречат общественной морали и принципам гуманизма. Уж не приведет ли способность ослушаться человеческих приказов к пресловутому «восстанию машин» - таким вопросом задаются противники «непослушных» роботов.

Хотя на самом деле речь идет всего лишь о защите от дурака - проверке перечня условий для выполнения той или иной задачи. Кстати, подобные технологии уже давно применяются для разграничения доступа и в целях передачи данных в информационно-вычислительных системах. Ведь от некорректного использования машинных функций в конечном счете окажется куда больше вреда, чем от запрета для отдельных операторов пользоваться этими функциями.

А три закона роботехники, возможно, будут служить яблоком раздора среди футурологов еще немало лет.Источник: "Тайны ХХ века"

Пророк XX века

Писатель сказал, что телефоны станут беспроводными и с экраном, а связь между абонентами на разных континентах будет осуществляться через спутники. «Вы сможете видеть человека, которому звоните. Дисплей можно будет использовать для просмотра документов, фотографий и чтения книг. Будут созданы миниатюрные электронные вычислительные машины, источником энергии для которых станут литий-ионные аккумуляторы».

Предвидел Азимов и появление телевизоров с плоскими экранами вместо обычных, и возникновение «объемного» кино.

Робот Nao может выполнить приказ, а может и отказаться

По поводу бытовой техники писатель спрогнозировал, что со временем она будет снабжена таймерами, большая ее часть станет беспроводной. Еще писатель объявил, что будут строиться огромные электростанции в пустынях. Они уже появились, но пока их не так много.

Законы роботехники

Но больше всего прославили Азимова как футуролога три закона роботехники, впервые упомянутые им в рассказе «Хоровод» (1942).

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат первому закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит первому или второму законам.

Позднее, в 1986 году, в романе «Роботы и Империя», Азимов добавил еще и нулевой закон роботехники: «Робот не может причинить вред человечеству или своим бездействием допустить, чтобы человечеству был причинен вред».

Правда, хоть Азимову и приписывают авторство пресловутых роботехнических законов, окончательно сформулировал их не он, а его друг Джон Кэмпбелл, главный редактор журнала фантастики Astounding, вычленивший содержание законов из написанных Азимовым текстов. Тем не менее писатель никогда не отказывался от авторства и не раз упоминал о трех законах в своем творчестве.

Люди ждут от роботов дружелюбия

Так, в эссе «Законы роботехники» Азимов писал, что действие трех законов можно распространить на все созданные человеком инструменты, а также социальные институты. Их суть в том, чтобы служить людям, не нанося им вреда и не нарушая их безопасности.

Опасность для будущего

И коллеги-фантасты, и ученые отнеслись к выкладкам Азимова достаточно серьезно. Им удалось обнаружить в трех законах немало противоречий, вследствие которых они малоприменимы на практике в наше время, когда технологии искусственного интеллекта наконец переживают бурное развитие.

Например, специалист по научной фантастике Роберт Сойер рассуждает: «Развитие искусственного интеллекта - это бизнес, а бизнес, как известно, не заинтересован в развитии коренных мер безопасности - особенно философских. Вот несколько примеров: табачная индустрия, автомобильная промышленность, ядерная промышленность. Ни для одной из них изначально не было сказано, что серьезные меры безопасности необходимы, и все они препятствовали внешне налагаемым ограничениям, и ни одна из них не приняла абсолютный эдикт против причинения вреда людям».

Но даже если иметь в виду только роботов, то законы роботехники являются скорее идеалом, чем реально работающим механизмом. Ведь, во-первых, роботу не всегда объяснишь, как верно поступать в той или иной ситуации, во-вторых, соблюдая законы, роботы ограничивают свободу людей, а это далеко не всегда идет на пользу, хотя вред может оказаться неочевидным и «отсроченным». Так, машины могут подобным образом лишать людей возможности совершать рискованные действия, направленные на различные открытия, создание изобретений и креативных проектов, которые в конечном счете будут способствовать прогрессу.

Тем не менее многие взяли три закона роботехники на вооружение. В 2007 году южнокорейское правительство начало разработку «Устава этических норм для роботов», основные положения которого напоминают азимовские законы.

Елиезер Юдковски из американского Института сингулярности (SIAI) изучает проблемы глобального риска, которые возникнут, если будущий искусственный сверхинтеллект не запрограммируют на дружественность по отношению к человеку. В 2004 году при SIAI был открыт сайт AsimovLaws.com, где обсуждались проблемы этики искусственного интеллекта. В частности, участники дискуссий пытались доказать, что применение трех законов роботехники небезопасно для человечества, так как, следуя им, машины могут захватить власть на Земле, дабы «защитить» людей от вреда.

Защита от дурака

И все-таки представим себе, что произошло бы, если бы законы, разработанные Азимовым и Кэмпбеллом много десятилетий назад, осуществлялись на практике хотя бы частично... Недавно команда специалистов из Университета Тафтса (США) разработала систему искусственного интеллекта, которая позволяет последнему отказываться выполнять приказы оператора при наличии на то достаточных оснований. Новинка была представлена на технологической конференции AI-HRI.

Писатель-фантаст и популяризатор науки Айзек Азимов

Принцип работы системы выглядит так. Получив от человека приказ, машина приступает к проверке условий его выполнения. Среди них наличие необходимых навыков, физическая возможность исполнения приказа вообще и с учетом текущих обстоятельств, а также такой параметр, как «субординация» - проверка того, обязан ли робот выполнять приказы, поступившие именно от этого оператора.

Если робот обнаруживает причины, по которым приказ не может быть выполнен, он уведомляет об этом человека. Однако после уточнения исходных данных машина может «передумать» и приступить к выполнению поставленной перед ней задачи.

В качестве примера ученые записали несколько видеороликов, в которых действует робот по имени Nao. В каждом из них оператор отдает роботу устные приказы, которые тот отказывается выполнять по разным причинам. При этом в двух случаях машина все же выполняет указание после того, как оператор уточняет данные, а в третьем отказывается его выполнять «наотрез», поскольку оператор не обладает необходимыми полномочиями.

Между тем некоторые исследователи в области робоэтики (этических аспектов роботехники), такие как Кейтлин Ричардсон и Эрик Бриллинг, считают, что подобные разработки противоречат общественной морали и принципам гуманизма. Уж не приведет ли способность ослушаться человеческих приказов к пресловутому «восстанию машин» - таким вопросом задаются противники «непослушных» роботов.

Хотя на самом деле речь идет всего лишь о защите от дурака - проверке перечня условий для выполнения той или иной задачи. Кстати, подобные технологии уже давно применяются для разграничения доступа и в целях передачи данных в информационно-вычислительных системах. Ведь от некорректного использования машинных функций в конечном счете окажется куда больше вреда, чем от запрета для отдельных операторов пользоваться этими функциями.

А три закона роботехники, возможно, будут служить яблоком раздора среди футурологов еще немало лет.Источник: "Тайны ХХ века"

Опубликовано 29 ноября 2016

| Комментариев 0 | Прочтений 3589

Ещё по теме...

Добавить комментарий

Из новостей

Периодические издания

Информационная рассылка: