Технологии, которых лучше бы никогда не существовало

Технологии по своей природе нейтральны. Их аморальность является мифом, который должен быть развеян. Каждый создатель может наполнить своё творение моралью, даже если оно само по себе её не имеет. В большинстве случаев люди этого не замечают, но некоторые современные технологии изначально рождены со злым умыслом.

Загляните подальше в 21-й век, и Вы увидите сияние фантастических технологических возможностей, которые уже ждут нас. Но если присмотреться, то Вы также заметите, что эти вещи несут с собой что-то ужасное. Составляя этот список, стало очевидно, что и этим технологиям можно найти полезное применение, поэтому стало важным четко очертить границы и возможности их использования со злым умыслом.

Например, нанотехнологии. С одной стороны они могут положить конец дефициту, практически в любой отрасли, они могут очистить окружающую среду, переделать человека (физиологически, биохимически и генетически), но с другой стороны их можно использовать, для уничтожения жизни на Земле за довольно короткий срок. Поэтому, когда приходит время для создания и развития технологий будущего, нам надо быть предельно осторожными.

Технологический прорыв – это не только преимущества, и искусственный интеллект может быть тому примером. Патрик Лин, директор «Ethics + Emerging Sciences Group» Калифорнийского политехнического государственного университета говорит: «Технологии по своей природе нейтральны. Их аморальность является мифом, который должен быть развеян. Каждый создатель может наполнить своё творение моралью, даже если оно само по себе её не имеет. В большинстве случаев люди этого не замечают, но некоторые современные технологии изначально рождены со злым умыслом. В любом случае все понимают, что большая часть создаваемых технологий может быть использована и во благо, и во вред. Если шансов использования во вред больше, тогда это может быть причиной того, что создавать данную технологию просто не стоит».

Итак, 10 технологий будущего, существование которых далеко неоднозначно...

Нанооружие

Ничто не может положить конец нашему царствованию здесь, на Земле, быстрее, чем оружие «молекулярной сборки».

Два очень мощных фактора рождают эту угрозу. Это неконтролируемое самовоспроизведение и самопроизвольное распространение подобного оружия с геометрической прогрессии. Правительство или простой человек может спроектировать микроскопические машины, которые будут потреблять конечные ресурсы нашей планеты со скоростью света и в то же самое время воспроизводить себя, создавая бесполезные продукты, под названием «серая слизь».

Теоретик Роберт Фрейтас, увлекаясь нанотехнологией, пришел к выводу, что в нашем мире возможно существование нескольких видов наноубийц: серая пыль, серый планктон, серый лишайник и так называемые убийцы биомасс. Серая пыль не будет пропускать солнечный свет, серый планктон будет создавать репликаторов подводного мира, которые будут поглощать богатый энергией подводный мир, серые лишайники уничтожат земную растительность, а убийцы биомасс будут нападать и уничтожать все возможные живые организмы.

По словам Фрейтаса, наихудший сценарий для человечества – это сценарий «глобальной экофагии» (экофагия или серая слизь — гипотетический сценарий конца света, связанный с успехом молекулярных нанотехнологий) займет около 20 месяцев, этого достаточно, чтобы заблаговременно создать эффективную защиту. В качестве защиты, Фрейтас имеет в виду контрмеры вероятно с участием самореплицирующихся нанотехнологий, или своего рода систем, которые нарушат внутренние механизмы наноботов. С другой стороны, мы могли бы создать «активные щиты» заранее, хотя большинство экспертов считают, что они будут бесполезны.

Машины с сознанием

Идея о том, что, в конце концов, мы наделим машину разумом, воспринимается уже вполне естественно. Но, сначала надо хорошо подумать, прежде чем сделать это. Создание машины с функционирующим мозгом внутри (в прямом и переносном смысле), которая сможет симулировать человека и животного, может оказаться опасным для нас самих.

Еще в 2003 году, философ Томас Метценже утверждал, что это было бы чудовищно неэтично разрабатывать программное обеспечение, которое может страдать.

Что бы Вы сказали, если бы кто-то пришел и сказал: «Мы хотим генетически модифицировать умственно отсталых младенцев для всеобщего научного прогресса. Нам нужны дети с определенными познавательными и эмоциональными ограничениями в целях изучения послеродового психологического развития!»

Вы бы определенно решили, что это не только абсурдная, ужасающая и аморальная идея. Надеюсь, что ни один комитет по этике не одобрит это в современном мире. Однако, сегодня комитет по этике не видит, это как прообраз первой машины наделенной разумом.

Футурист Луи Хелм согласен с этой точкой зрения. Вот, что он сказал:

Поместить сознание внутрь машины, и заставить её делать работу за нас, по сути, означает настоящее рабство. Кроме того, сознание – действительно хрупкая вещь. Всего несколько неверно закодированных генов в организме человека могут вызвать синдром Дауна, шизофрению, аутизм или эпилепсию. Страшно осознавать, что ты изначально запрограммирован на дисфункции. А ведь именно так будут запрограммированы мыслящие машины.

Например, несколько хорошо финансируемых разработчиков AI (Artificial intelligence – Искусственный интеллект) хотят воссоздать человеческий интеллект в машинах, имитируя биологическую структуру человеческого мозга. Для того, чтобы не допустить крах общества, оно не должно допустить создание искусственного интеллекта с самосознанием. Не потому что это не круто или невозможно, а просто потому, что использование сознательного существа, пусть даже робота, по сути, и есть рабство.

Искусственный суперинтеллект

Как заявил в этом году Стивен Хокинг «создание искусственного интеллекта может стать нашей самой большой ошибкой за всю историю». В самом деле, как мы уже не раз отмечали, появление суперинтеллекта может оказаться катастрофическим для на самих. Внедрение систем, которые будут гораздо быстрее и умнее нас, заставит нас отойти в сторону. Мы просто будем прислуживать на милость суперинтеллекту – и не факт, что мы сможем создать AI с дружественными намерениями, так что создание супер AI будет полным безумием.

Путешествие во времени

Если рассуждать здраво, то, по существу, путешествие во времени – самая невозможная из всех технологий. Но, если это будет возможно, надо держаться подальше от этого. Это будет невероятно опасно. Любой научно-фантастический фильм о смещенных временных промежутках обязательно наталкивает на мысль о потенциальных опасностях подобного путешествия. И даже если некоторые формы квантового путешествия во времени возможны, культурный и технологический обмен между разнородными цивилизациями может плохо закончиться.

Устройства, читающие мысли

Уже сегодня есть успехи в создании машин, которые могут читать мысли и воспоминания людей на расстоянии, причем без их согласия. Но, вероятно, это станет возможным только после того, как человеческий мозг каким-либо образом будет интегрирован в интернет-сети или другие средства коммуникации.

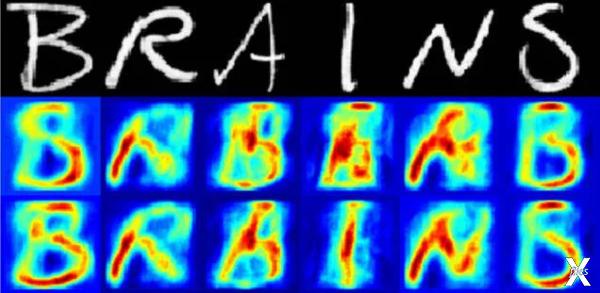

В прошлом году, например, ученые из Нидерландов использовали данные из алгоритмов сканирования мозга, чтобы определить на какие буквы смотрел человек. Эксперимент оказался настоящим прорывом, и показал, что уже сейчас есть возможность восстанавливать человеческие мысли с достаточно высоким уровнем детализации, включая информацию о том, что мы видим, думаем и помним. Такие устройства, если они будут массово использоваться в каком-либо тоталитарном режиме, сделают жизнь невыносимой. Это будет своего рода мир Оруэлла, в котором действительно будет существовать наказание за «мысленные преступления».

Устройства, «взламывающие» мозг

Еще одна возможность изменить наше сознание против нашей воли и без нашего ведома. Как только в наш мозг установят какой-либо чип, мы станем беззащитны перед влиянием на них извне и наши умы будут доступны в сети Интернет, примерно также, как Ваше устройство, с которого Вы сейчас читаете эту статью.

Невероятно, но мы уже сделали первые шаги к этой цели. Недавно международная группа нейробиологов поставили эксперимент, который позволил участникам общаться через Интернет по сути с помощью так называемой «цифровой телепатии». Конечно, это здорово, но это цифровая телепатия может открыть ящик Пандоры. Возможно, один из возможных вариантов развития событий описан в «Призраке в доспехах», где хакером был искусственный интеллект, способный модифицировать воспоминания и намерения своих жертв. А теперь представьте, это оружие в руках организованной преступности или параноидальных правительств.

Автономные роботы-убийцы

Эта проблема уже сегодняшнего дня. Вот что по этому поводу сказал футурист Майкл Ла Торра:

Большая опасность таится в международной гонке вооружения, которая может начаться, если какая-нибудь нация введет в строй подобного рода войска. Через несколько циклов усовершенствования такой техники, её уровень может превзойти все мыслимые и немыслимые грани. Автономные роботы смогут поражать любые системы, контролируемые человеком. Затем, либо по случайности, либо уже по злому умыслу, человечество окажется в полном подчинении искусственного интеллекта.

Вирусы

Еще одна очень плохая идея. Еще в 2005 году Рэй Курцвейл и Билл Джой отметили, что публикация геномов смертельных вирусов – это как рецепт блинчиков, но в итоге получиться продукт для уничтожения всей жизни на Земле. Всегда есть вероятность того, что какой-нибудь идиот или фанат воссоздаст вирус или усовершенствует существующий, чтобы сделать его еще более эффективным, и затем «выпустит» в мир. Было подсчитано, что, например, модифицированный птичий грипп может убить половину населения планеты. Так вот исследователи из Китая объединили птичий и свинной грипп, создав вирус-мутант, передающийся воздушно-капельным путем. Идея, что врага надо знать в лицо, конечно хороша, но всё-таки стоит помнить тот факт, что вирусы-мутанты могут быть использованы как оружие для нападения. Также, всегда есть опасность того, что вирус может вырваться из лаборатории и посеять хаос.

Виртуальные тюрьмы и наказания

Какие будут тюрьмы и наказания, когда люди смогут жить в течение сотен или тысяч лет? Специалист по этике Ребекка Роуч видит следующий сценарий развития событий:

Но скорей всего к тому времени появятся способы программирования активности человеческого мозга. Запрограммировав мозг осужденного на сверхбыструю работу, мы сможем превратить его 8.5 часовое пребывание за решеткой в 1000 летнюю каторгу. Очевидно, что это будет гораздо дешевле, чем отбывание 1000-летнего наказания в реальном времени.

Это конечно хорошо, но также есть этико-моральная сторона этого вопроса.

Проектирование ада

Это чем-то похоже на предыдущую «технологию». Некоторые футуристы также говорят об использовании передовых технологий, особенно для сознания загрузки виртуальной реальности прямо в мозг человека. Как хорошо прийти после тяжелого рабочего дня, подключить мозг к сети и оказаться в раю. Но если можно создать рай, то можно создать и ад. На самом деле, это одна из худших идей, которую можно себе представить. Это еще одна причина, по которой стоит запретить разработку искусственного суперинтеллекта из-за страха наступления так называемой эры Василиска Роко.

И учитывая тот факт, что современные люди подсели на современные технологии (соцсети например), будущее человечества в паре с высокими технологиями не кажется столь безоблачным.Источник: "GIMODO"

Загляните подальше в 21-й век, и Вы увидите сияние фантастических технологических возможностей, которые уже ждут нас. Но если присмотреться, то Вы также заметите, что эти вещи несут с собой что-то ужасное. Составляя этот список, стало очевидно, что и этим технологиям можно найти полезное применение, поэтому стало важным четко очертить границы и возможности их использования со злым умыслом.

Например, нанотехнологии. С одной стороны они могут положить конец дефициту, практически в любой отрасли, они могут очистить окружающую среду, переделать человека (физиологически, биохимически и генетически), но с другой стороны их можно использовать, для уничтожения жизни на Земле за довольно короткий срок. Поэтому, когда приходит время для создания и развития технологий будущего, нам надо быть предельно осторожными.

Технологический прорыв – это не только преимущества, и искусственный интеллект может быть тому примером. Патрик Лин, директор «Ethics + Emerging Sciences Group» Калифорнийского политехнического государственного университета говорит: «Технологии по своей природе нейтральны. Их аморальность является мифом, который должен быть развеян. Каждый создатель может наполнить своё творение моралью, даже если оно само по себе её не имеет. В большинстве случаев люди этого не замечают, но некоторые современные технологии изначально рождены со злым умыслом. В любом случае все понимают, что большая часть создаваемых технологий может быть использована и во благо, и во вред. Если шансов использования во вред больше, тогда это может быть причиной того, что создавать данную технологию просто не стоит».

Итак, 10 технологий будущего, существование которых далеко неоднозначно...

Нанооружие

Ничто не может положить конец нашему царствованию здесь, на Земле, быстрее, чем оружие «молекулярной сборки».

Два очень мощных фактора рождают эту угрозу. Это неконтролируемое самовоспроизведение и самопроизвольное распространение подобного оружия с геометрической прогрессии. Правительство или простой человек может спроектировать микроскопические машины, которые будут потреблять конечные ресурсы нашей планеты со скоростью света и в то же самое время воспроизводить себя, создавая бесполезные продукты, под названием «серая слизь».

Теоретик Роберт Фрейтас, увлекаясь нанотехнологией, пришел к выводу, что в нашем мире возможно существование нескольких видов наноубийц: серая пыль, серый планктон, серый лишайник и так называемые убийцы биомасс. Серая пыль не будет пропускать солнечный свет, серый планктон будет создавать репликаторов подводного мира, которые будут поглощать богатый энергией подводный мир, серые лишайники уничтожат земную растительность, а убийцы биомасс будут нападать и уничтожать все возможные живые организмы.

По словам Фрейтаса, наихудший сценарий для человечества – это сценарий «глобальной экофагии» (экофагия или серая слизь — гипотетический сценарий конца света, связанный с успехом молекулярных нанотехнологий) займет около 20 месяцев, этого достаточно, чтобы заблаговременно создать эффективную защиту. В качестве защиты, Фрейтас имеет в виду контрмеры вероятно с участием самореплицирующихся нанотехнологий, или своего рода систем, которые нарушат внутренние механизмы наноботов. С другой стороны, мы могли бы создать «активные щиты» заранее, хотя большинство экспертов считают, что они будут бесполезны.

Машины с сознанием

Идея о том, что, в конце концов, мы наделим машину разумом, воспринимается уже вполне естественно. Но, сначала надо хорошо подумать, прежде чем сделать это. Создание машины с функционирующим мозгом внутри (в прямом и переносном смысле), которая сможет симулировать человека и животного, может оказаться опасным для нас самих.

Еще в 2003 году, философ Томас Метценже утверждал, что это было бы чудовищно неэтично разрабатывать программное обеспечение, которое может страдать.

Что бы Вы сказали, если бы кто-то пришел и сказал: «Мы хотим генетически модифицировать умственно отсталых младенцев для всеобщего научного прогресса. Нам нужны дети с определенными познавательными и эмоциональными ограничениями в целях изучения послеродового психологического развития!»

Вы бы определенно решили, что это не только абсурдная, ужасающая и аморальная идея. Надеюсь, что ни один комитет по этике не одобрит это в современном мире. Однако, сегодня комитет по этике не видит, это как прообраз первой машины наделенной разумом.

Футурист Луи Хелм согласен с этой точкой зрения. Вот, что он сказал:

«Одно из самых главных преимуществ компьютеров заключается в том, что Вы можете задать им миллион программ и задач, и им не будет скучно выполнять их, как это было бы с человеком, который еще бы и обиделся за такой объем работы. Поскольку мы планируем использовать искусственный интеллект вместо человеческого интеллектуального труда, я думаю, это было бы аморально намеренно программировать машины с сознанием»

Поместить сознание внутрь машины, и заставить её делать работу за нас, по сути, означает настоящее рабство. Кроме того, сознание – действительно хрупкая вещь. Всего несколько неверно закодированных генов в организме человека могут вызвать синдром Дауна, шизофрению, аутизм или эпилепсию. Страшно осознавать, что ты изначально запрограммирован на дисфункции. А ведь именно так будут запрограммированы мыслящие машины.

Например, несколько хорошо финансируемых разработчиков AI (Artificial intelligence – Искусственный интеллект) хотят воссоздать человеческий интеллект в машинах, имитируя биологическую структуру человеческого мозга. Для того, чтобы не допустить крах общества, оно не должно допустить создание искусственного интеллекта с самосознанием. Не потому что это не круто или невозможно, а просто потому, что использование сознательного существа, пусть даже робота, по сути, и есть рабство.

Искусственный суперинтеллект

Как заявил в этом году Стивен Хокинг «создание искусственного интеллекта может стать нашей самой большой ошибкой за всю историю». В самом деле, как мы уже не раз отмечали, появление суперинтеллекта может оказаться катастрофическим для на самих. Внедрение систем, которые будут гораздо быстрее и умнее нас, заставит нас отойти в сторону. Мы просто будем прислуживать на милость суперинтеллекту – и не факт, что мы сможем создать AI с дружественными намерениями, так что создание супер AI будет полным безумием.

Путешествие во времени

Если рассуждать здраво, то, по существу, путешествие во времени – самая невозможная из всех технологий. Но, если это будет возможно, надо держаться подальше от этого. Это будет невероятно опасно. Любой научно-фантастический фильм о смещенных временных промежутках обязательно наталкивает на мысль о потенциальных опасностях подобного путешествия. И даже если некоторые формы квантового путешествия во времени возможны, культурный и технологический обмен между разнородными цивилизациями может плохо закончиться.

Устройства, читающие мысли

Уже сегодня есть успехи в создании машин, которые могут читать мысли и воспоминания людей на расстоянии, причем без их согласия. Но, вероятно, это станет возможным только после того, как человеческий мозг каким-либо образом будет интегрирован в интернет-сети или другие средства коммуникации.

В прошлом году, например, ученые из Нидерландов использовали данные из алгоритмов сканирования мозга, чтобы определить на какие буквы смотрел человек. Эксперимент оказался настоящим прорывом, и показал, что уже сейчас есть возможность восстанавливать человеческие мысли с достаточно высоким уровнем детализации, включая информацию о том, что мы видим, думаем и помним. Такие устройства, если они будут массово использоваться в каком-либо тоталитарном режиме, сделают жизнь невыносимой. Это будет своего рода мир Оруэлла, в котором действительно будет существовать наказание за «мысленные преступления».

Устройства, «взламывающие» мозг

Еще одна возможность изменить наше сознание против нашей воли и без нашего ведома. Как только в наш мозг установят какой-либо чип, мы станем беззащитны перед влиянием на них извне и наши умы будут доступны в сети Интернет, примерно также, как Ваше устройство, с которого Вы сейчас читаете эту статью.

Невероятно, но мы уже сделали первые шаги к этой цели. Недавно международная группа нейробиологов поставили эксперимент, который позволил участникам общаться через Интернет по сути с помощью так называемой «цифровой телепатии». Конечно, это здорово, но это цифровая телепатия может открыть ящик Пандоры. Возможно, один из возможных вариантов развития событий описан в «Призраке в доспехах», где хакером был искусственный интеллект, способный модифицировать воспоминания и намерения своих жертв. А теперь представьте, это оружие в руках организованной преступности или параноидальных правительств.

Автономные роботы-убийцы

Эта проблема уже сегодняшнего дня. Вот что по этому поводу сказал футурист Майкл Ла Торра:

«У нас еще пока нет такой машины, которая демонстрировала бы общий уровень интеллекта как у человека, но робоубийцам особого ума не надо. Создание роботизированных боевых машин всех видов уже поставлено на поток. Робо -танки, -самолеты, -корабли, -подводные лодки, и человекоподобные робосолдаты существуют уже сегодня. В отличие от дистанционно управляемых беспилотных самолетов, военные роботы могут определять цели и уничтожать их без участия человека, отдавая самим себе окончательный приказ «огонь». Опасность таких технологий очевидна, потому что даже современные, контролируемые солдатами, роботы уже много десятков раз ошибочно убивали своих же, или даже невинных гражданских лиц»

Большая опасность таится в международной гонке вооружения, которая может начаться, если какая-нибудь нация введет в строй подобного рода войска. Через несколько циклов усовершенствования такой техники, её уровень может превзойти все мыслимые и немыслимые грани. Автономные роботы смогут поражать любые системы, контролируемые человеком. Затем, либо по случайности, либо уже по злому умыслу, человечество окажется в полном подчинении искусственного интеллекта.

Вирусы

Еще одна очень плохая идея. Еще в 2005 году Рэй Курцвейл и Билл Джой отметили, что публикация геномов смертельных вирусов – это как рецепт блинчиков, но в итоге получиться продукт для уничтожения всей жизни на Земле. Всегда есть вероятность того, что какой-нибудь идиот или фанат воссоздаст вирус или усовершенствует существующий, чтобы сделать его еще более эффективным, и затем «выпустит» в мир. Было подсчитано, что, например, модифицированный птичий грипп может убить половину населения планеты. Так вот исследователи из Китая объединили птичий и свинной грипп, создав вирус-мутант, передающийся воздушно-капельным путем. Идея, что врага надо знать в лицо, конечно хороша, но всё-таки стоит помнить тот факт, что вирусы-мутанты могут быть использованы как оружие для нападения. Также, всегда есть опасность того, что вирус может вырваться из лаборатории и посеять хаос.

Виртуальные тюрьмы и наказания

Какие будут тюрьмы и наказания, когда люди смогут жить в течение сотен или тысяч лет? Специалист по этике Ребекка Роуч видит следующий сценарий развития событий:

«Преимущества радикального увеличения продолжительности жизни очевидны, но это также может стать причиной увеличения суровости наказания. Представим, что человек может жить 1000 и более лет, тогда для него 5-50 лет будет незначительным сроком, следовательно продолжительность заключения по всем преступлениям будет расти.

Но возникнет проблема, когда законопослушные граждане будут обязаны оплачивать 100-500 лет содержания преступника, и это вполне разумно. Это, конечно же, будет бить по карману общества. Однако, если увеличение продолжительности жизни было повсеместно, эти затраты могли бы быть компенсированы возросшими взносами более долгоживущих представителей рабочей силы»

Но скорей всего к тому времени появятся способы программирования активности человеческого мозга. Запрограммировав мозг осужденного на сверхбыструю работу, мы сможем превратить его 8.5 часовое пребывание за решеткой в 1000 летнюю каторгу. Очевидно, что это будет гораздо дешевле, чем отбывание 1000-летнего наказания в реальном времени.

Это конечно хорошо, но также есть этико-моральная сторона этого вопроса.

Проектирование ада

Это чем-то похоже на предыдущую «технологию». Некоторые футуристы также говорят об использовании передовых технологий, особенно для сознания загрузки виртуальной реальности прямо в мозг человека. Как хорошо прийти после тяжелого рабочего дня, подключить мозг к сети и оказаться в раю. Но если можно создать рай, то можно создать и ад. На самом деле, это одна из худших идей, которую можно себе представить. Это еще одна причина, по которой стоит запретить разработку искусственного суперинтеллекта из-за страха наступления так называемой эры Василиска Роко.

Василиск Роко - это богоподобная форма искусственного интеллекта, опасная настолько, что если Вы просто о ней подумаете, то проведете остаток дней в ужасающих пытках

И учитывая тот факт, что современные люди подсели на современные технологии (соцсети например), будущее человечества в паре с высокими технологиями не кажется столь безоблачным.Источник: "GIMODO"

Опубликовано 14 сентября 2022

| Комментариев 0 | Прочтений 808

Ещё по теме...

Добавить комментарий

Из новостей

Периодические издания

Информационная рассылка: